الوصف

كود MATLAB للورقة التالية جاهز للتنزيل

أوجاستا ، م. جثسيال ، وت.كاثيرفالافاكومار. “خوارزمية تقديرية جديدة تعتمد على معامل النطاق للتشتت والانحراف لمصنف الشبكات العصبية.” الحوسبة الناعمة التطبيقية 12.2 (2012): 619-625.

هذا الرمز مع مثالين على مجموعتي بيانات.

خلاصة :

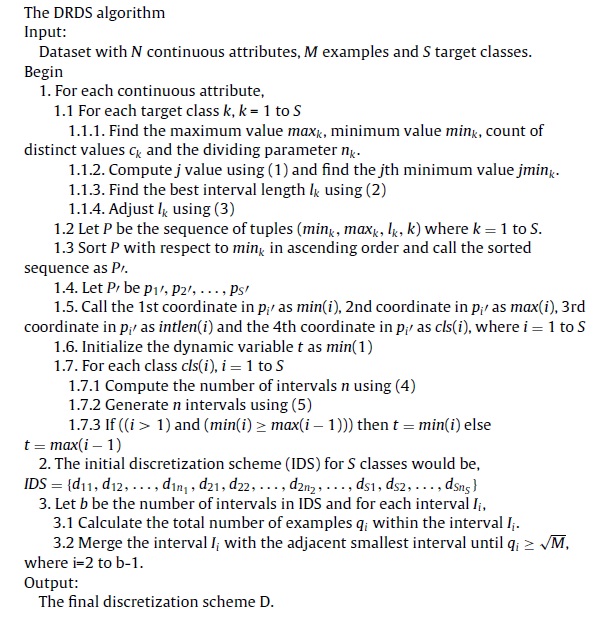

في هذا البحث نقترح خوارزمية جديدة ثابتة وعالمية وخاضعة للإشراف وتزايدية ومن أسفل إلى أعلى تعتمد على معامل التشتت وانحراف نطاق البيانات. يقوم بأتمتة عملية التقدير من خلال إدخال عدد الفواصل الزمنية ومعيار التوقف. تظهر النتائج التي تم الحصول عليها باستخدام خوارزمية التقديرية هذه أن مخطط التقديرية الذي تم إنشاؤه بواسطة الخوارزمية يحتوي تقريبًا على الحد الأدنى من الفواصل الزمنية ويتطلب أصغر وقت تقديري. تُستخدم الشبكة العصبية الأمامية مع خوارزمية تدريب التدرج المترافق لحساب دقة التصنيف من البيانات التي يتم تقديرها بواسطة هذه الخوارزمية. تظهر كفاءة الخوارزمية المقترحة من حيث أفضل مخطط تقديري ودقة تصنيف أفضل من خلال تنفيذها على ست مجموعات بيانات حقيقية مختلفة.

يتم تقديم طريقة تقدير مطورة حديثًا. إنها تحدد السمات المستمرة بناءً على معامل النطاق للتشتت وانحراف البيانات ، وبالتالي فإن الطريقة المقترحة هي التقديرية بناءً على معامل النطاق للتشتت وانحراف البيانات (DRDS).

تُقاس جودة التقدير من خلال عاملين ، وهما دقة التصنيف وعدد فترات التقديرية [22]. المزيد من الفواصل التقديرية دائمًا أقل في التصنيف

الأخطاء وخفض تكلفة تقدير البيانات [23]. تتكون طريقة DRDS من مرحلتين. اهتمت المرحلة الأولى فقط بتقليل أخطاء التصنيف ، مما أدى إلى مزيد من الفواصل الزمنية في مخطط التقدير الأولي (IDS) والمرحلة الثانية مهتمة بتقليل عدد الفترات دون التأثير على دقة التصنيف عن طريق دمج الفترات في نظام تحديد الهوية. من المرحلة 2 ، يتم الحصول على مخطط التقدير النهائي (FDS).

references :

[1] J. Han, M. Kamber, Data Mining: Concepts and Techniques, Morgan Kaufman,2001.

[2] K.J. Cios, L.A. Kurgan, CLIP 4: hybrid inductive machine learning algorithm that generates inequality rules, Information Science 163 (2004) 37–83.

[3] P. Clark, T. Niblett, The CN2 algorithm, Machine Learning 3 (1989) 261–283.

[4] L.A. Kurgan, K.J. Cios, CAIM discretization algorithm, IEEE Transactions on knowledge and Data Engineering 16 (2004) 145–152.

[5] C.J. Tsai, C.I. Lee, W.P. Yang, A discretization algorithm based on class-attribute contingency coefficient, Information Sciences 178 (2008) 714–731.

[6] R. Butterworth, D.A. Simovici, G.S. Santos, L.O. Machado, A greedy algorithm for supervised discretization, Biomedical Informatics 37 (2004) 285–292.

[7] U.M. Fayyad, K.B. Irani, Multi-interval discretization of continuous-valued attributes for classification learning, in: Proc. of Thirteenth Int. Conf. on Artificial Intelligence, 1993, pp. 1022–1027.

[8] P. Soman, S. Diwakar, V. Ajay, Insight into Data Mining, Prentice Hall of India, 2006.

[9] R. Kerber, ChiMerge: discretization of numeric attributes, in: Proc. of Ninth Int. Conf. on Artificial Intelligence, 1992, pp. 123–128.

[10] H. Liu, R. Setiono, Feature selection via discretization, IEEE Transactions on Knowledge and Data Engineering 9 (1997) 642–645.

[11] F. Tay, L. Shen, A modified chi2 algorithm for discretization, IEEE Transactions on Knowledge and Data Engineering 14 (2002) 666–670.

[12] C.T. Su, J.H. Hsu, An extended chi2 algorithm for discretization of real value attributes, IEEE Transactions on Knowledge and Data Engineering 17 (2005) 437–441.

[13] Q. Wu, D.A. Bell, T.M. McGinnity, G. Prasad, G. Qi, X. Huang, Improvement of decision accuracy using discretization of continuous attributes, in: Proc. of the Third Int. Conf. on Fuzzy Systems and Knowledge Discovery, Lecture Notes in Computer Science, 4223, 2006, pp. 674–683.

[14] S. Cohen, L. Rokach, O. Maimon, Decision-tree instance-space decomposition with grouped gain-ratio, Information Sciences 177 (2007) 3592–3612.

[15] R.R. Yager, An extension of the naive Bayesian classifier, Information Sciences 176 (2006) 577–588.

[16] K. Kaikhah, S. Doddmeti, Discovering trends in large datasets using neural network, Applied Intelligence 29 (2006) 51–60.

[17] S. Ozekes, O. Osman, Classification and prediction in datamining with neural networks, Electrical and Electronics Engineering 3 (2003) 707–712.

[18] H. Lu, R. Setiono, H. Liu, Neurorule: a connectionist approach to data mining, in: Proc. of VLDB’95, 1995, pp. 478–489.

[19] Z.H. Zhou, Y. Jiang, S.F. Chen, General neural framework for classification rule mining, International Journal of Computers, Systems and Signals 1 (2000) 154–168.

[20] H. Dam, H.A. Abbass, C. Lokan, X. Yao, Neural based learning classifier systems, IEEE Transactions on Knowledge and Data Engineering 20 (2008) 26–39.

[21] F. Moller, A scaled conjugate gradient algorithm for fast supervised learning, Neural Networks 6 (1990) 525–533.

[22] X. Liu, H. Wang, A discretization algorithm based on heterogeneity criterion, IEEE Transactions on Knowledge and Data Engineering 17 (2005) 1166–1173.

[23] R. Jin, Y. Breitbart, C. Muoh, Data discretization unification, Knowledge and Information Systems 19 (2009) 1–29.

[24] S.C. Gupta, V.K. Kapoor, Fundamentals of Mathematical Statistics, Sultan Chand & Sons, New Delhi, 2001.

[25] J. Alcalá-Fdez, L. Sánchez, S. García, M.J. del Jesus, S. Ventura, J.M. Garrell, J. Otero, C. Romero, J. Bacardit, V.M. Rivas, J.C. Fernández, F. Herrera, KEEL: a software tool to assess evolutionary algorithms to data mining problems, Soft Computing 13 (3) (2009) 307–318.

المراجعات

لا توجد مراجعات بعد.